负载均衡是一种在多个计算资源之间分配工作负荷的技术,以提高系统的可扩展性、可用性和性能,在计算机系统中,负载均衡通常用于分发网络流量、处理任务队列和调度计算资源等场景,本文将详细介绍负载均衡的原理、技术分类、应用场景以及实现方法。

负载均衡原理

负载均衡的基本原理是在多个计算资源之间分配工作负荷,使得每个资源都能得到充分利用,从而提高整个系统的性能,负载均衡的核心目标是实现资源的高效利用和故障容错,当某个计算资源出现故障时,负载均衡器会自动将流量切换到其他可用资源,保证服务的连续性。

负载均衡技术分类

根据负载均衡的实现方式和技术特点,可以将负载均衡技术分为以下几类:

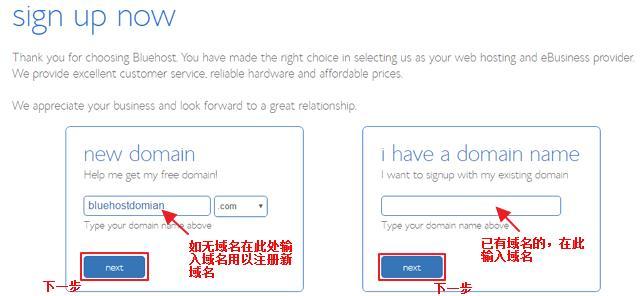

1、基于DNS的负载均衡:通过修改域名解析记录,将用户请求引导到不同的服务器,这种方法适用于HTTP、FTP等应用层协议,但不适用于TCP协议。

2、基于IP地址的负载均衡:通过修改IP地址列表,将用户请求分发到不同的服务器,这种方法适用于TCP协议,但不适用于HTTP、FTP等应用层协议。

3、基于应用层的负载均衡:通过修改HTTP请求头或者URL中的参数,将用户请求分发到不同的服务器,这种方法适用于HTTP、HTTPS等应用层协议。

4、基于数据链路层的负载均衡:通过修改MAC地址列表,将用户请求分发到不同的服务器,这种方法适用于以太网等数据链路层协议。

5、基于操作系统内核的负载均衡:通过修改操作系统内核的网络栈,将用户请求分发到不同的服务器,这种方法适用于Linux、Windows等操作系统。

负载均衡应用场景

负载均衡技术广泛应用于各种场景,以下是一些常见的应用场景:

1、网站和应用托管:通过负载均衡器分发用户请求,提高网站的响应速度和可用性。

2、数据库集群:通过负载均衡器分发数据库查询请求,提高数据库的处理能力。

3、文件存储和备份:通过负载均衡器分发文件读写请求,提高文件存储和备份的性能。

4、云服务和虚拟化:通过负载均衡器分发虚拟机实例的请求,提高云服务和虚拟化的性能和可用性。

负载均衡实现方法

实现负载均衡的方法有很多,以下是一些常见的实现方法:

1、硬件负载均衡器:使用专门的硬件设备实现负载均衡功能,如F5、Citrix等品牌的产品。

2、软件负载均衡器:使用软件实现负载均衡功能,如Nginx、HAProxy等开源项目。

3、DNS负载均衡:通过修改DNS解析记录实现负载均衡功能,如Amazon Route 53、Cloudflare等服务。

4、CDN(内容分发网络):通过CDN服务提供商的边缘节点实现负载均衡功能,如阿里云CDN、腾讯云CDN等服务。

相关问题与解答

1、问题:负载均衡器和代理服务器有什么区别?

解答:负载均衡器主要用于分发工作负荷到多个计算资源,以提高系统的可扩展性、可用性和性能;而代理服务器主要用于转发客户端和服务器之间的网络请求,以提高访问速度和安全性,简单来说,负载均衡器关注的是工作负荷的分配,而代理服务器关注的是网络请求的转发。

2、问题:如何选择合适的负载均衡算法?

解答:选择合适的负载均衡算法取决于具体的应用场景和需求,常见的负载均衡算法有轮询(Round Robin)、加权轮询(Weighted Round Robin)、最少连接(Least Connections)等,可以根据系统的并发量、响应时间和资源利用率等因素来选择合适的算法。

3、问题:如何评估负载均衡器的性能?

解答:评估负载均衡器的性能可以从以下几个方面进行:吞吐量(Throughput)、延迟(Latency)、连接数(Connections)、错误率(Error Rate)等,可以通过压力测试和性能监控工具来获取这些指标的数据,以便对负载均衡器的性能进行评估和优化。

4、问题:如何处理负载均衡器的单点故障?

解答:为了解决负载均衡器的单点故障问题,可以采用高可用(High Availability)的设计策略,常见的高可用方案包括主备模式(ActiveStandby)、集群模式(Cluster)和地理冗余模式(Geographical Redundancy)等,通过这些方案,可以确保在负载均衡器出现故障时,系统仍然能够正常工作。